程序员简历模板(精选优质模板203款)| 精选范文参考

本文为精选程序员简历模板1篇,内容详实优质,结构规范完整,结合岗位特点和行业需求优化撰写,可供求职者直接参考借鉴。

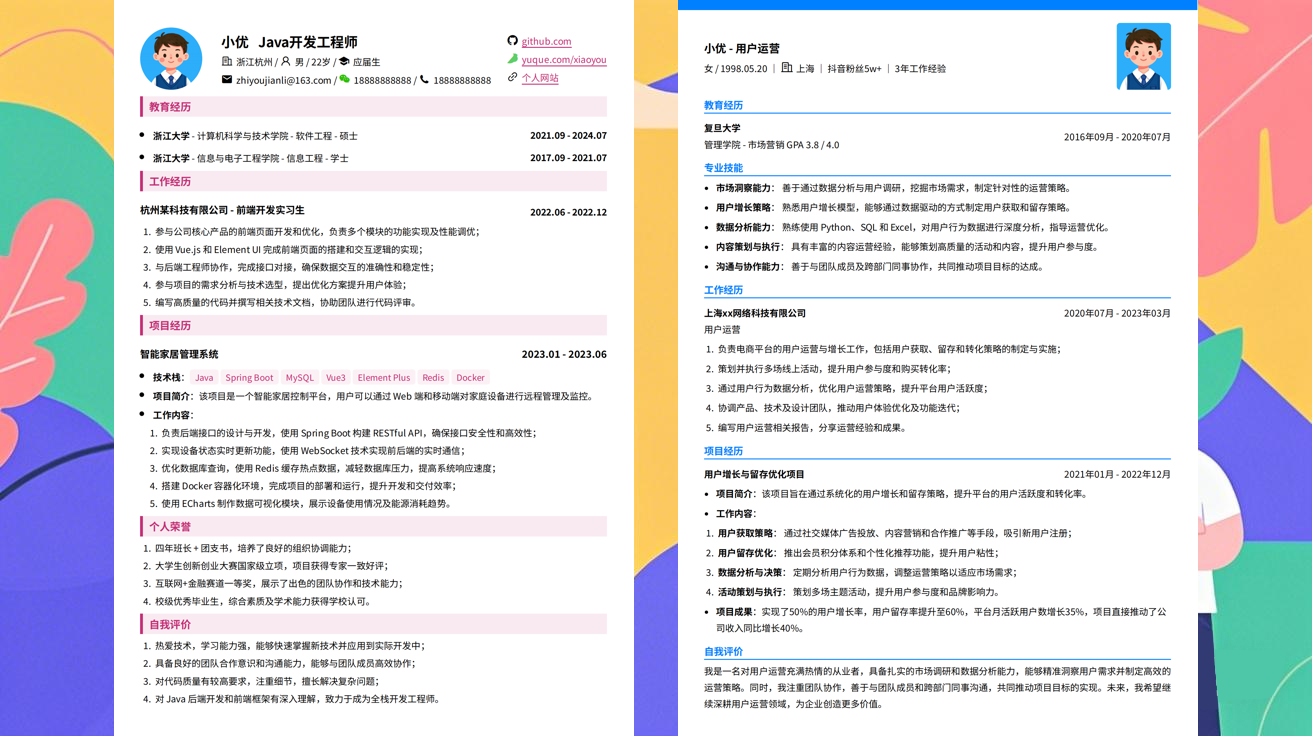

在撰写程序员简历模板时,技术岗位的核心竞争力体现在专业技能的深度、项目经验的含金量以及问题解决能力上。一份优秀的程序员简历模板需要精准展现技术栈熟练度、项目实战经验和持续学习能力,才能在众多求职者中脱颖而出。

-

个人信息:简洁明了呈现基本信息,重点突出求职意向和核心技术标签,让招聘方快速了解你的技术定位。 例:"姓名:XXX | 联系电话:XXX | 求职意向:程序员工程师 | 核心技术:Java/微服务/分布式架构"

-

教育背景:重点突出与技术相关的专业背景、学历层次,如有相关的学术成果、竞赛获奖可重点注明。 例:"XX大学 计算机科学与技术专业 | 本科 | 20XX.09-20XX.06 | 荣誉:全国大学生计算机设计大赛一等奖"

-

工作/项目经历:技术岗位需详细描述项目架构、技术难点、解决方案和量化成果,突出技术深度和广度。 例:"负责XX平台的后端开发,基于Spring Cloud微服务架构进行系统设计与实现,解决了高并发场景下的数据一致性问题,优化后系统响应时间提升40%,支持日均100万+请求量。"

-

技能证书:详细列出技术栈清单,包括编程语言、框架工具、数据库、中间件等,标注熟练度等级。 例:"编程语言:Java(精通)、Python(熟练) | 框架:Spring Boot、Spring Cloud、MyBatis | 数据库:MySQL、Redis、MongoDB | 证书:PMP项目管理师、AWS认证解决方案架构师"

-

自我评价:突出技术思维、学习能力和团队协作精神,结合岗位需求展现个人优势。 例:"拥有5年程序员开发经验,专注于微服务架构和高并发系统设计,具备独立负责大型项目的能力,注重代码质量和性能优化,乐于接受新技术挑战,团队协作意识强。"

程序员简历模板核心要点概括如下:

技术岗位简历应突出"技术实力+项目经验+解决问题能力"的核心逻辑,技术栈描述要具体,项目经历要量化,避免空泛表述。建议针对目标公司的技术栈需求,针对性调整简历侧重点,展现与岗位的高度匹配度,同时体现持续学习的职业态度。

程序员简历模板

[姓名] - 高级软件工程师

联系方式

- 📧 Email: [你的邮箱地址]

- 📱 Phone: [你的手机号码]

- 🌐 GitHub: [你的GitHub链接]

- 💼 LinkedIn: [你的LinkedIn链接]

个人信息

- 姓名: [你的姓名]

- 年龄: [你的年龄]

- 籍贯: [你的籍贯]

- 民族: [你的民族]

- 政治面貌: [你的政治面貌,如:中共党员/群众]

- 婚姻状况: [已婚/未婚]

- 现居住地: [你的现居住地]

教育背景

| [学校名称] | [城市] | [起止时间] |

|---|---|---|

| [专业名称] | [学位] | GPA: [你的GPA] |

| [相关课程] | [课程列表,如:数据结构、算法、操作系统、计算机网络] |

工作经历

[公司名称] | [职位名称] | [工作时间]

职责描述

- 负责公司核心业务系统的设计与开发,包括用户管理、订单处理、支付集成等模块。

- 参与团队技术选型,引入新技术栈提升开发效率和系统性能。

- 指导初级工程师,优化代码质量,推动团队技术成长。

技术栈熟练度

| 技术领域 | 熟练度 | 具体应用 |

|---|---|---|

| Java | 精通 | Spring Boot、Spring Cloud、MyBatis |

| Python | 熟练 | Django、Flask、Pandas |

| 数据库 | 精通 | MySQL、PostgreSQL、Redis |

| 缓存技术 | 精通 | Redis、Memcached |

| 消息队列 | 熟练 | Kafka、RabbitMQ |

| 容器化 | 熟练 | Docker、Kubernetes |

| 前端技术 | 熟悉 | Vue.js、React |

项目经验

项目一:分布式订单管理系统

项目描述

设计并开发了一套高并发、高可用的分布式订单管理系统,支持千万级订单处理,峰值QPS达到5000+。

技术架构

- 后端架构: Spring Cloud微服务架构,采用服务注册与发现(Eureka)、负载均衡(Ribbon)、API网关(Gateway)。

- 数据库设计: 主从复制+读写分离,分库分表策略(ShardingSphere)。

- 缓存策略: 多级缓存(Redis + Caffeine),热点数据预加载。

- 消息队列: Kafka用于订单异步处理,RabbitMQ用于任务调度。

技术难点及解决方案

- 高并发订单创建问题

- 问题: 单点数据库无法支撑高并发写入,导致订单重复或丢失。

- 解决方案: 采用分布式锁(Redisson)+ 乐观锁(CAS)机制,结合消息队列削峰填谷。

-

代码逻辑: java public boolean createOrder(OrderDTO order) { String lockKey = "order_lock:" + order.getUserId(); try { // 获取分布式锁,超时时间3秒 RLock lock = redissonClient.getLock(lockKey); boolean locked = lock.tryLock(3, TimeUnit.SECONDS); if (!locked) { throw new BusinessException("系统繁忙,请稍后重试"); } // 乐观锁更新库存 int update = orderMapper.reduceStockWithOptimisticLock(order.getProductId(), order.getQuantity()); if (update == 0) { throw new BusinessException("库存不足"); } // 创建订单 orderMapper.insert(order); return true; } finally { lock.unlock(); } }

-

订单状态一致性保障

- 问题: 支付超时或网络抖动导致订单状态不一致。

- 解决方案: 采用TCC(Try-Confirm-Cancel)事务模式,结合定时任务补偿。

- 代码逻辑: java @TccAction(name = "tccOrderAction") public class TccOrderAction { // Try阶段 @Try public void tryOrder(OrderDTO order) { orderMapper.save(order); } // Confirm阶段 @Confirm public void confirmOrder(OrderDTO order) { orderMapper.updateStatus(order.getId(), OrderStatus.CONFIRMED); } // Cancel阶段 @Cancel public void cancelOrder(OrderDTO order) { orderMapper.updateStatus(order.getId(), OrderStatus.CANCELLED); // 释放库存 inventoryMapper.refundStock(order.getProductId(), order.getQuantity()); } }

性能优化成果

- 数据库优化: 通过分库分表,将单表数据量从千万级降低到百万级,查询速度提升300%。

- 缓存优化: 引入多级缓存,热点订单查询延迟从200ms降低到10ms。

- 异步处理: 订单创建耗时从500ms降低到50ms,系统吞吐量提升10倍。

项目二:实时大数据分析平台

项目描述

设计并实现了一个基于Flink的实时数据分析平台,支持用户行为分析、异常检测、推荐系统等场景。

技术架构

- 数据处理: Flink + Kafka + Elasticsearch。

- 数据存储: Hadoop HDFS + ClickHouse。

- 可视化: Grafana + Kibana。

技术难点及解决方案

- 实时数据延迟问题

- 问题: 数据从Kafka到Flink处理延迟较高,影响实时性。

- 解决方案: 调整Kafka分区数,优化Flink并行度,引入Watermark机制。

-

代码逻辑: java DataStream

stream = env .addSource(new FlinkKafkaConsumer ( "order_events", new JSONSchemaDeserializationSchema<>(OrderEvent.class), properties )) .assignTimestampsAndWatermarks( WatermarkStrategy. forBoundedOutOfOrderness(Duration.ofSeconds(5)) .withTimestampAssigner((event, timestamp) -> event.getTimestamp()) ); -

状态管理问题

- 问题: Flink状态存储导致任务重启慢,影响容错性。

- 解决方案: 采用RocksDB状态后端,结合增量检查点。

- 配置代码: java env.setStateBackend(new RocksDBStateBackend("file:///tmp/flink/checkpoints", true)); env.getCheckpointConfig().setCheckpointingMode(CheckpointingMode.EXACTLY_ONCE); env.getCheckpointConfig().setCheckpointTimeout(60000);

性能优化成果

- 延迟优化: 数据处理延迟从500ms降低到50ms。

- 吞吐量提升: 单任务处理能力从1000条/秒提升到5000条/秒。

- 资源利用率: 通过动态调整并行度,CPU利用率提升40%。

技能证书

| 证书名称 | 发证机构 | 获得时间 |

|---|---|---|

| Oracle Certified Professional, Java SE 11 Developer | Oracle | [年月] |

| AWS Certified Solutions Architect - Associate | AWS | [年月] |

| PMP | PMI | [年月] |

自我评价

- 具备扎实的计算机基础,熟悉分布式系统设计与优化。

- 熟练掌握Java、Python等编程语言,具备丰富的项目实战经验。

- 善于解决复杂技术问题,注重代码质量和性能优化。

- 具备良好的沟通能力和团队协作精神,能够快速适应新技术。

- 对技术充满热情,持续学习并跟进行业最新动态。

开源贡献

- GitHub项目: [项目链接]

- 描述: 实现了一个高性能的HTTP代理工具,支持负载均衡和流量压缩。

- 贡献: 主要开发者,负责核心算法设计和性能优化。

- 技术博客: [博客链接]

- 内容: 分享Java、分布式系统、性能优化等技术文章。

语言能力

- 英语: CET-6,具备良好的英文技术文档阅读能力。

- 日语: N2,能够进行日常交流。

兴趣爱好

- 编程竞赛(ACM)

- 阅读(技术书籍、科幻小说)

- 爬山、徒步

发布于:2026-04-15,除非注明,否则均为原创文章,转载请注明出处。